Cuando hablamos de hacerle finetuning a una inteligencia artificial, muchas personas imaginan algo muy simple: uno toma un modelo, lo entrena, mira una métrica y se queda con el resultado total más alto. En teoría suena razonable. En la práctica no siempre funciona así.

NOFRAUD ha consolidado un dataset de 15mil casos reales de conductas deshonestas recolectadas durante 12 años y con este dataset ha entrenado un LLM que detecta el fraude mejor de lo que podría hacerlo GPT, Gemini o Claude.

Eso fue exactamente lo que nos pasó en uno de nuestros entrenamientos recientes. Logramos ajustar un modelo de lenguaje LLM para la detección de conductas deshonestas usando 3500 casuísticas y la técnica LoRA, aplicada sobre GPT-OSS. El entrenamiento funcionó, las métricas mejoraron y el resultado final fue sólido, pero lo más interesante no fue eso, lo más interesante fue descubrir que la versión del modelo con la mejor métrica no era la mejor versión para el negocio y esa diferencia, que puede parecer pequeña, cambia por completo la forma de pensar implementar una IA que detecte fraudes en una empresa.

El problema no es entrenar un modelo

El objetivo del entrenamiento es mejorar la capacidad de un LLM base para identificar en el lenguaje corporativo patrones que indiquen un acto anti ético y que pudieran ser relevantes en contextos de fraude y corrupción. Para ello utilizamos un conjunto de 3500 ejemplos reales, dividido en entrenamiento (80%) y evaluación (20%) y afinamos el modelo usando la técnica LoRA.

Hasta ahí todo entra dentro de lo esperado en un proyecto de IA aplicada. Pero hay una pregunta que muchas veces se pasa por alto: una vez el modelo empieza a mejorar, ¿cómo decidimos cuál es la mejor versión para usar en la vida real?

Porque una cosa es que una versión del modelo “se vea bien” en una tabla y otra muy distinta es que realmente se comporte de la forma que el negocio necesita.

La trampa de una sola métrica

Durante el entrenamiento el sistema va guardando distintas versiones intermedias del modelo para poder compararlas entre sí. Algunas versiones son más estrictas, otras más equilibradas, otras más “atrevidas” a la hora de marcar casos sospechosos. Y en medio de esas comparaciones apareció una situación muy reveladora.

Hubo una versión del modelo que alcanzó una precisión de 0.9619 sobre los casos positivos. Ese número es altísimo y visto por encima podría llevar a cualquiera a pensar: “listo, ya encontramos el mejor modelo”. Sin embargo, esa misma versión tenía un recall de 0.5941, lo que significaba que estaba dejando por fuera demasiados casos realmente importantes.

- Precisión significa: de todo lo que el modelo marcó como sospechoso, cuánto realmente sí lo era?

- Recall significa: de todo lo que realmente era sospechoso, cuánto logró detectar?

En otras palabras: esa versión del modelo era muy buena para no equivocarse cuando decía “esto sí me preocupa”, pero al mismo tiempo era demasiado conservadora y dejaba escapar demasiadas señales relevantes. Para un sistema antifraude, eso puede ser un problema serio.

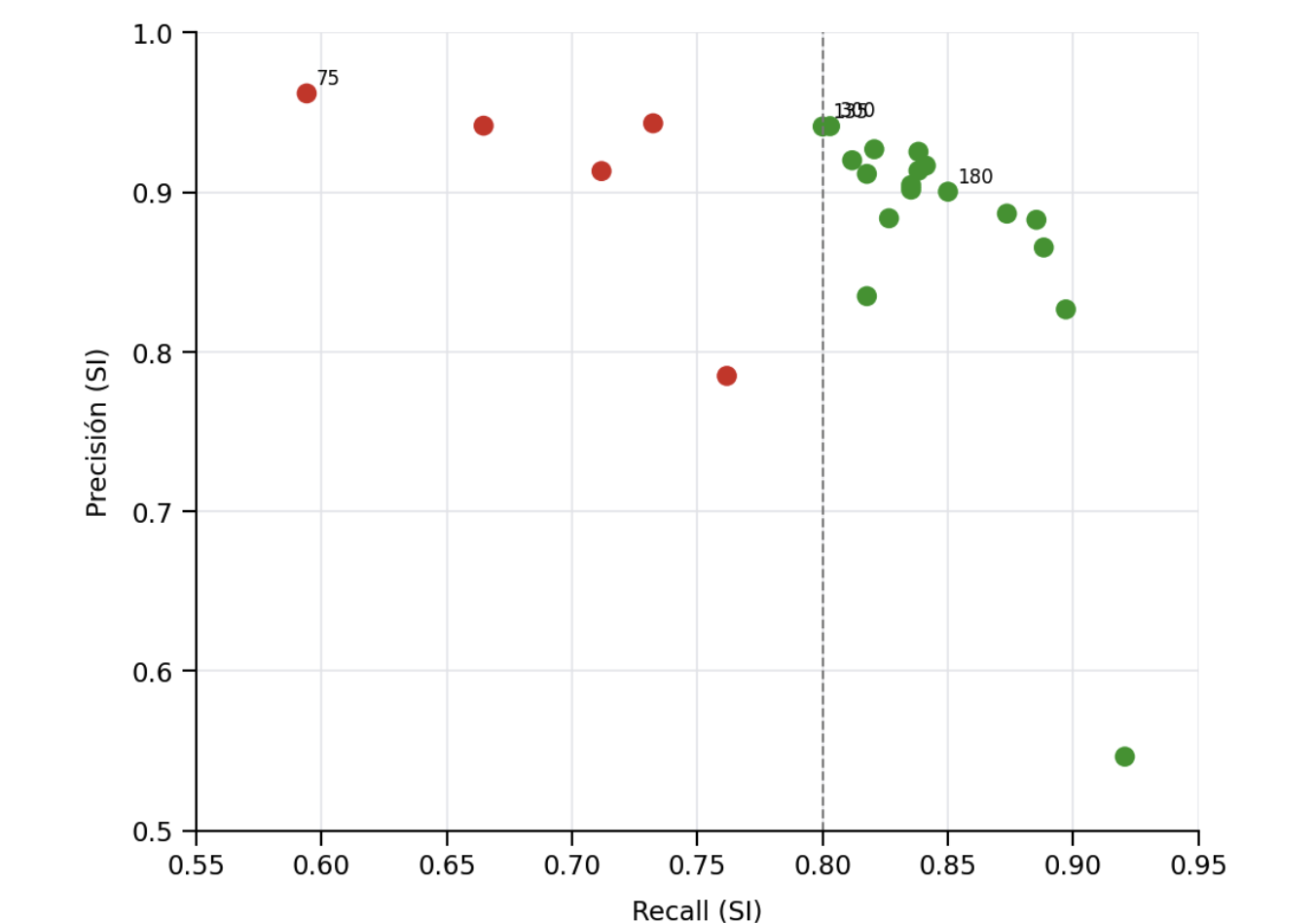

Esta gráfica muestra una idea muy importante. Cada punto representa una versión distinta del modelo durante el entrenamiento. En el eje horizontal está la capacidad de capturar casos relevantes (recall) y en el vertical la limpieza o confiabilidad de las alertas emitidas (precisión).

A simple vista, uno podría sentirse tentado a irse por el punto con la precisión más alta. Y de hecho ese punto existe: corresponde a la versión que alcanzó 0.9619 en precisión. El problema es que ese mismo punto se quedó en 0.5941 de recall, muy por debajo del nivel mínimo que queríamos aceptar para este caso.

Por eso la línea vertical en 0.80 es tan importante. Esa línea marca la frontera de negocio: a la derecha están las versiones del modelo que sí cumplen el nivel mínimo de cobertura que necesitábamos; a la izquierda están las que, aunque lucen muy bien en una métrica, no servían para el objetivo real.

La gráfica entonces no debe leerse como “cuál punto es más bonito”, sino como “cuál punto combina mejor rigor y utilidad”. Y bajo esa lógica, la versión que terminó ganando no fue la más extrema, sino la más equilibrada.

La decisión no es técnica

Aquí fue donde dejamos de hacernos la pregunta tradicional de machine learning: ¿cuál versión tiene la métrica más alta?, y empezamos a hacernos una pregunta mucho más útil:

¿Cuál versión del modelo toma decisiones más compatibles con el riesgo que una empresa está dispuesta a asumir?

Porque en fraude, compliance o auditoría no basta con tener un modelo “elegante” en papel. Si el sistema es demasiado estricto, puede dejar pasar comportamientos que sí deberían llamar la atención. Y si es demasiado permisivo, puede generar demasiado ruido operativo.

Por esa razón definimos una regla simple pero poderosa: la versión elegida debía mantener un nivel mínimo de capacidad para detectar casos relevantes (recall) y, dentro de ese grupo de candidatos, escoger la opción más fuerte en precisión y con mejor estabilidad general. Esa lógica quedó parametrizada en el entrenamiento con un umbral mínimo de recall(SI) de 0.80 y una banda de tolerancia sobre la precisión para romper empates usando la pérdida de evaluación.

Dicho de otra manera: no elegimos la versión que más brillaba en una sola cifra; elegimos la que mejor respetaba una política de negocio.

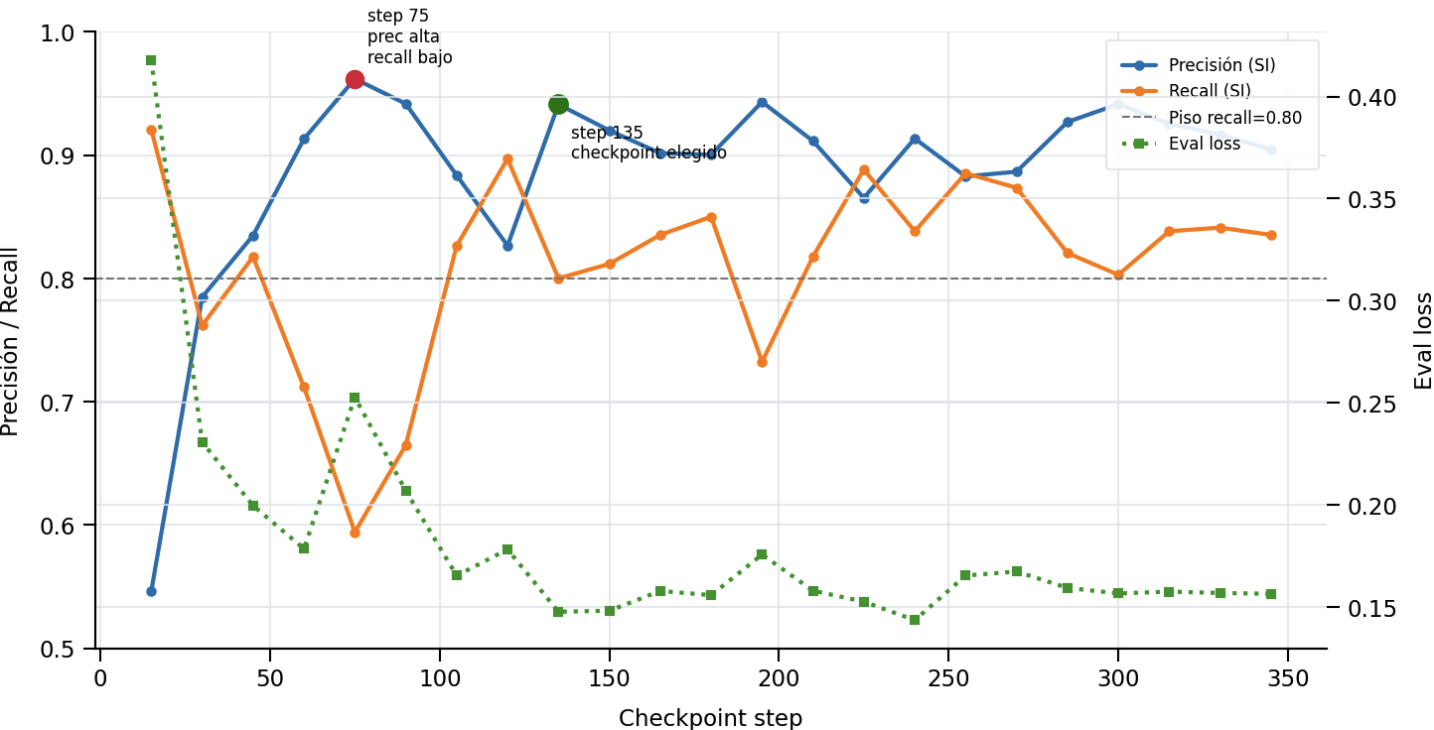

Esta gráfica cuenta la historia del entrenamiento en el tiempo. Muestra cómo fueron cambiando tres cosas a medida que el modelo aprendía: la precisión, el recall y la pérdida de evaluación.

Lo interesante de esta figura es que deja ver algo que muchas personas no imaginan cuando oyen hablar de IA: un modelo puede mejorar en un aspecto mientras empeora en otro.

Al comienzo del proceso, por ejemplo, el modelo era mucho más “sensible”: detectaba más casos, pero se equivocaba más. Luego fue ganando criterio, mejoró bastante en precisión y redujo la pérdida. Pero en ciertos momentos esa mejora vino acompañada de una caída fuerte en recall. Eso fue precisamente lo que ocurrió con la versión que tenía la mejor precisión: parecía excelente, pero estaba sacrificando demasiada capacidad de detección.

La lección aquí es muy valiosa incluso para quienes no trabajan en IA: optimizar una sola cifra puede llevarte a una peor decisión global. Y eso no solo pasa en machine learning; pasa también en estrategia, en finanzas, en ventas y en dirección empresarial.

El mejor equilibrio

Después de aplicar la regla de negocio, la versión seleccionada del modelo fue la correspondiente al step 135, es decir, una de las versiones intermedias guardadas durante el entrenamiento. Esa versión alcanzó precisión(SI) de 0.9411, recall(SI) de 0.8000 y eval_loss de 0.1476, y fue la que finalmente se cargó para la evaluación final.

El resultado global sobre el conjunto de evaluación fue bastante sólido:

- Metrica

- Accuracy

- F1 para la clase SI

- F1 Macro

- Verdaderos negativos

- Falsos positivos

- Falsos negativos

- Verdadedors positivos

- Muestras evaluadas

- Valor

- 0.8786

- 0.8649

- 0.8773

- 343

- 17

- 68

- 272

- 700

A nosotros estos números nos gustan no porque sean “bonitos”, sino porque reflejan una decisión consciente. No representan un modelo elegido por inercia, sino un modelo elegido con criterio.

Referencias

(NOFRAUD, 2025) The Fraud Explorer y FraudGPT

Acerca de NOFRAUD

NOFRAUD es la compañía que desarrolla el software antifraude The Fraud Explorer y apoya a personas y empresas a enfrentar y solucionar sus retos en materia de fraude interno, corrupción y abuso corporativo. NOFRAUD ha creado la base de datos conductual de actos deshonestos más grande del mundo en Español e Inglés, que sirve para que la inteligencia artificial encuentre patrones sospechosos de corrupción al interior de las organizaciones.

Mejoramos la capacidad de las organizaciones incrementando sus beneficios, arrebatándole a los perpetradores la posibilidad de afectar negativamente los ingresos a través del fraude, la corrupción, el abuso corporativo y la generación de ambientes tóxicos.

Contacte conmigo en » jrios@nofraud.la y Visítenos en » www.nofraud.la.