Hay una idea que se ha vuelto casi automática en inteligencia artificial: si un modelo es más famoso, más grande o más avanzado, entonces debería rendir mejor en casi cualquier tarea. Suena lógico pero no siempre es cierto.

NOFRAUD ha creado un LLM personalizado llamado FraudGPT a partir de un finetuning de GPT-OSS que supera las capacidades del modelo más poderoso de OpenAI a la fecha: GPT 5.4 Frontier, en tareas de detección de fraudes.

Acabamos de comprobarlo en una evaluación real de detección antifraude. Pusimos a competir dos enfoques distintos sobre exactamente el mismo conjunto de casos: por un lado, FraudGPT, un modelo que afinamos específicamente para detección de comportamientos sospechosos y por el otro, OpenAI GPT 5.4, un modelo generalista de frontera, muy potente y diseñado para resolver una enorme variedad de tareas.

El resultado fue claro: en esta prueba concreta, el modelo especializado tomó mejores decisiones.

Comparamos marcas y no filosofías

Esta comparación no era solamente un duelo entre un modelo LLM propio y uno comercial. En el fondo, era una comparación entre dos maneras de entender la inteligencia artificial.

La primera es la que hoy domina la conversación pública: usar un modelo generalista, muy capaz, que sabe “un poco de todo” y confiar en que eso será suficiente. La segunda es menos vistosa, pero muchas veces más poderosa: tomar un modelo y enseñarle a pensar mejor sobre un problema muy específico.

Ese fue precisamente el camino de FraudGPT. Lo afinamos con 12mil ejemplos orientados a una tarea puntual: decidir si un mensaje corporativo puede ser relevante para identificar actos antiéticos, riesgosos o sospechosos en contexto empresarial. El modelo final fue elegido después de una evaluación interna cuidadosa, precisamente para privilegiar el equilibrio entre exactitud y utilidad operativa.

Dicho en palabras simples: no construimos un modelo para responder de todo; lo entrenamos para juzgar mejor un tipo de problema muy particular.

Comparación sencilla pero reveladora

La prueba se hizo sobre 700 casos de evaluación, separados del entrenamiento, usando el mismo conjunto para ambos modelos. No era una comparación “decorativa”, ni una impresión subjetiva basada en unos pocos ejemplos. Era la misma prueba para los dos, con la misma tarea y el mismo criterio de evaluación.

Eso importa mucho, porque a veces en IA se comparan sistemas en condiciones distintas y luego se sacan conclusiones demasiado grandes. Aquí no: ambos modelos se enfrentaron al mismo examen y al mismo conjunto de datos que jamás habían visto y fue precisamente ahí donde la especialización empezó a mostrar su valor.

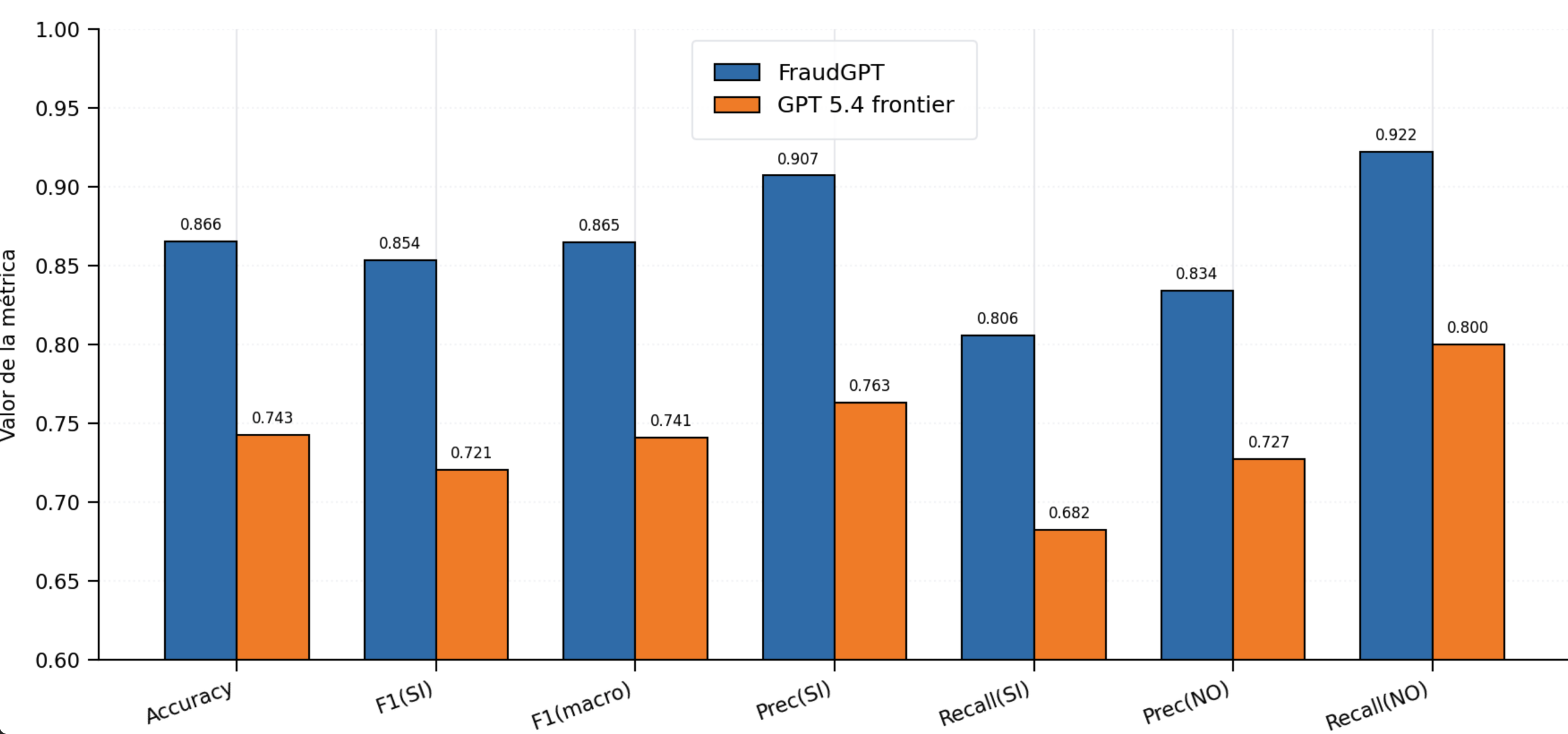

Esta gráfica resume la comparación general entre ambos modelos. No se trata de una victoria marginal en una sola métrica: FraudGPT supera a GPT 5.4 frontier en exactitud global, en F1, en precisión y en recall. Lo importante aquí no es solo “ganar” numéricamente, sino que la mejora aparece de forma consistente en todo el tablero.

FraudGPT acertó mas y molestó menos

Si uno mira los resultados desde arriba, ya hay una diferencia fuerte: FraudGPT obtuvo una exactitud general de 86.57%, mientras que GPT 5.4 quedó en 74.29%.

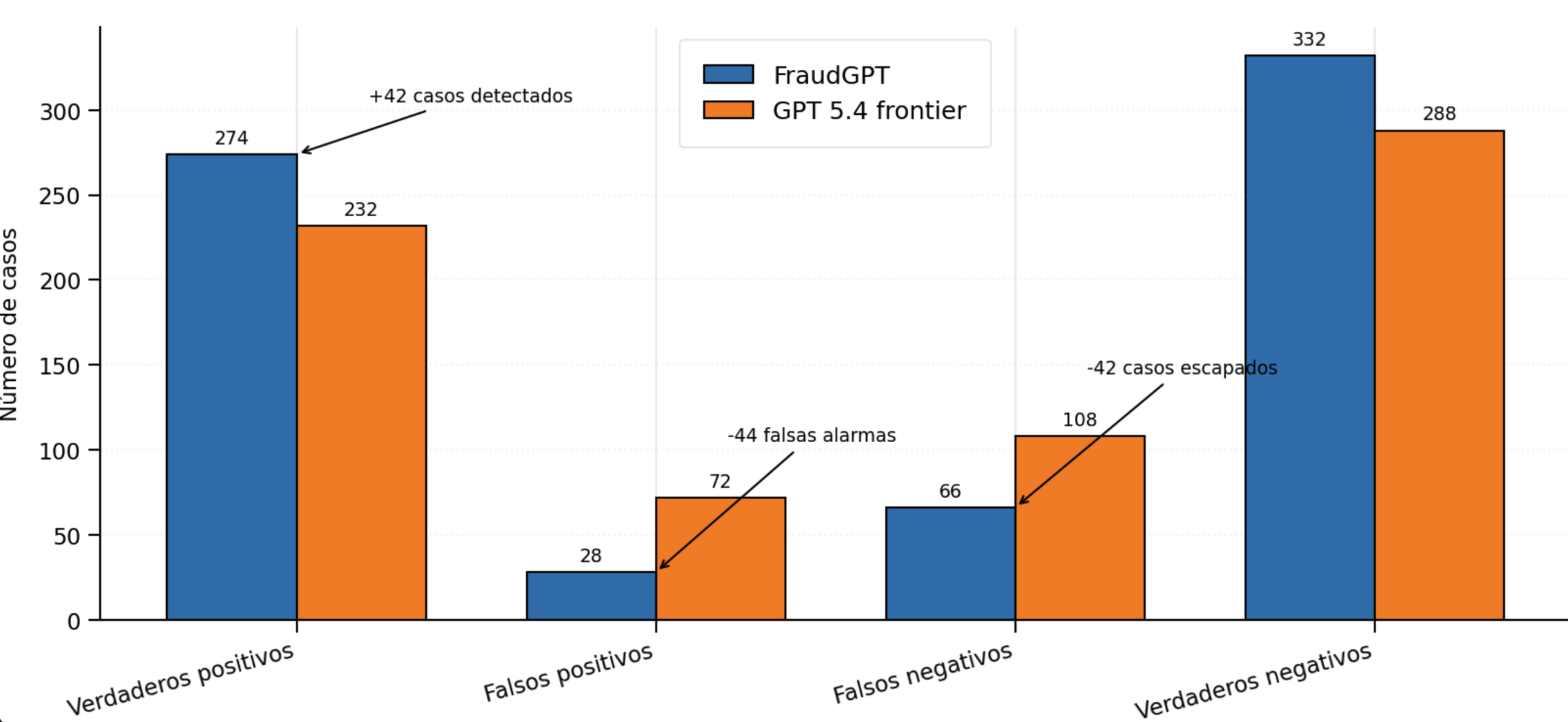

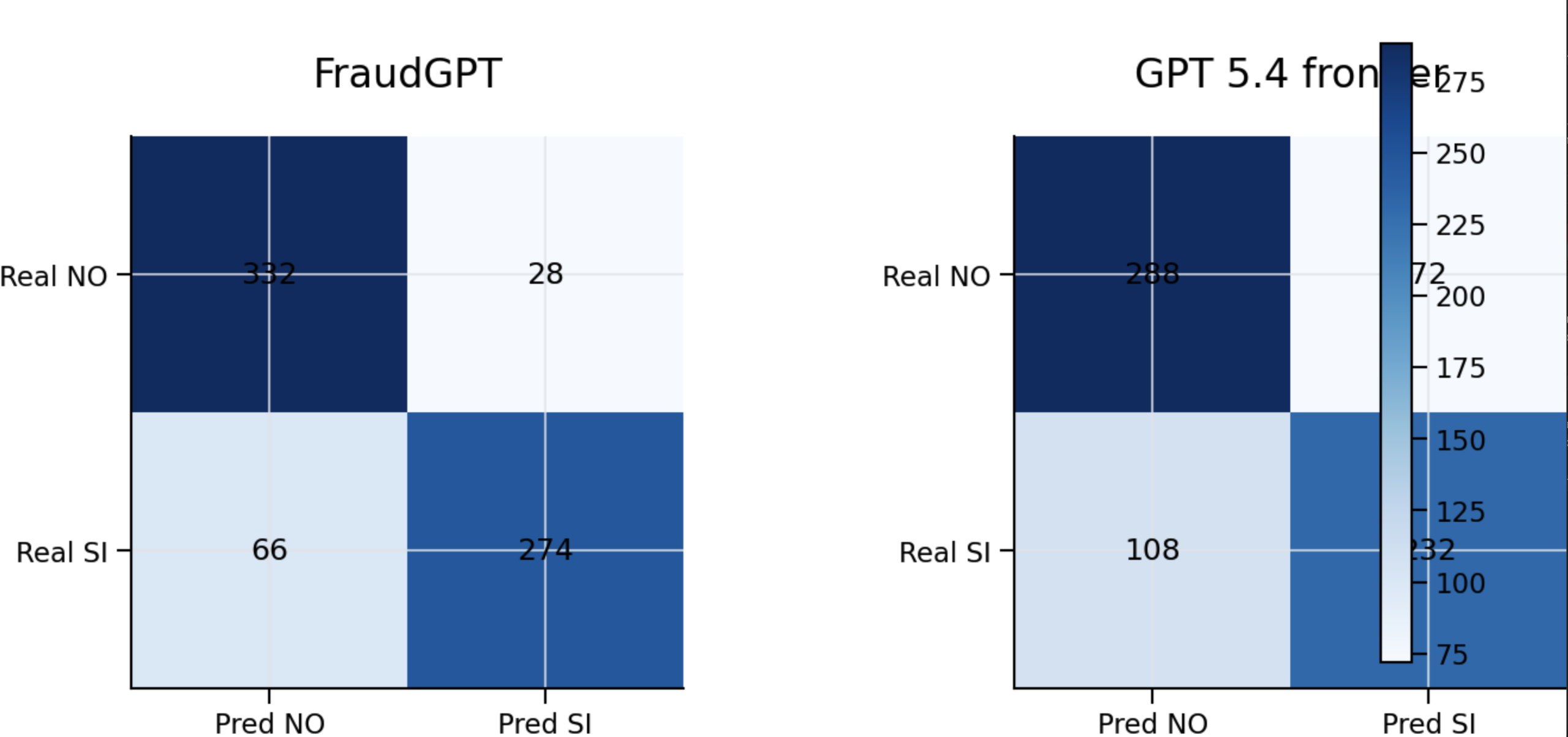

Pero lo más interesante no está solo en ese número. Está en la forma en que se repartieron los errores. FraudGPT identificó 274 casos positivos reales, mientras que GPT 5.4 identificó 232. Eso significa que el modelo especializado logró encontrar 42 casos relevantes adicionales.

Al mismo tiempo, FraudGPT produjo 28 falsas alarmas, mientras que GPT 5.4 produjo 72. Es decir: además de encontrar más casos verdaderamente importantes, el modelo especializado generó 44 alertas innecesarias menos. Todavía hay un dato más importante: FraudGPT dejó escapar 66 casos, mientras que GPT 5.4 dejó escapar 108. En otras palabras, el modelo afinado perdió 42 casos menos.

Para una persona de negocio, esto se puede resumir de una manera muy concreta: FraudGPT encontró más señales útiles y, al mismo tiempo, generó menos ruido.

Esa combinación es muy poderosa porque en entornos de fraude, auditoría, compliance o riesgos no basta con “detectar mucho”. Si un sistema se vuelve insoportablemente ruidoso, el equipo deja de confiar en él y si se vuelve demasiado conservador, deja escapar justo los casos que más deberían llamar la atención.

Lo valioso aquí es que el modelo especializado FraudGPT mejoró en las dos direcciones que más importan: más detección real y menos fricción operativa.

Por qué FraudGPT pudo ganarle a OpenAI GPT 5.4

GPT 5.4 es un modelo muy potente. Pero precisamente porque está diseñado para muchas tareas, no necesariamente está optimizado para los matices lingüísticos, contextuales y de negocio que aparecen en una tarea antifraude.

FraudGPT, en cambio, fue entrenado específicamente para ese tipo de señales. No se le pidió ser un todólogo. Se le pidió ser mejor juez en un problema muy concreto y aquí aparece una analogía que ayuda mucho a entender esto:

Si alguien necesita una opinión médica general, un buen médico generalista puede resolver muchísimas cosas. Pero si el problema es muy específico y delicado, muchas veces el mejor resultado no viene del profesional más “universal”, sino del especialista que ha pasado más tiempo enfrentándose a ese tipo de casos.

Con los modelos de IA pasa algo parecido: un modelo generalista puede ser brillante y muy versátil. Pero cuando la tarea exige un criterio fino en un dominio específico, la especialización empieza a pesar más que la amplitud.

Eso no significa que los frontier models sean malos. Significa algo más interesante: ser excelente en general no garantiza ser la mejor opción para una tarea empresarial muy concreta.

El futuro de la IA en las empresas

Los modelos generalistas seguirán siendo impresionantes y muy valiosos. Pero el verdadero diferencial competitivo para muchas empresas no estará solamente en “usar el modelo más avanzado”, sino en especializar correctamente modelos para problemas de alto valor.

La carrera de la IA no se gana simplemente descargando la última novedad del mercado. Se gana cuando se logra traducir conocimiento del negocio en un criterio que el modelo pueda aprender.

Referencias

(NOFRAUD, 2025) The Fraud Explorer y FraudGPT

Acerca de NOFRAUD

NOFRAUD es la compañía que desarrolla el software antifraude The Fraud Explorer y apoya a personas y empresas a enfrentar y solucionar sus retos en materia de fraude interno, corrupción y abuso corporativo. NOFRAUD ha creado la base de datos conductual de actos deshonestos más grande del mundo en Español e Inglés, que sirve para que la inteligencia artificial encuentre patrones sospechosos de corrupción al interior de las organizaciones.

Mejoramos la capacidad de las organizaciones incrementando sus beneficios, arrebatándole a los perpetradores la posibilidad de afectar negativamente los ingresos a través del fraude, la corrupción, el abuso corporativo y la generación de ambientes tóxicos.

Contacte conmigo en » jrios@nofraud.la y Visítenos en » www.nofraud.la.